想象一下一个复杂的、自我学习的算法;一个可以交流、模仿人类互动并创造内容的算法。不,这不是科幻电影中的情节。我们谈论的是语言学习模型(LLMs),它是多维技术的一个分支,正在全球范围内迅速普及和应用。LLM 的迷人能力为我们带来了无尽的可能性,但与任何技术突破一样,LLM 也有一个极具挑战性的方面--控制不可预见和不受欢迎的行为。.

Anthropic 是一家人工智能研究公司,它提出了一个创新的解决方案。该公司的前沿研究引入了 “角色载体”,作为管理、预测和遏制法律硕士不法行为的一种方式,从而引发了一场围绕负责任地使用和监管这一智能技术的富有成效的对话。.

让人工智能更负责任

虽然法律硕士的能力可能令人印象深刻,但他们的不可预测性可能会导致不受欢迎的后果。一个用心良苦的 LLM 最终可能会传播攻击性、误导性甚至危险的内容。对于一项被誉为人机关系未来的技术来说,这种行为是一个重大障碍。.

这就是 Anthropic 的角色向量发挥作用的地方。这项技术为开发人员提供了一种类似于操作绳索的工具,一种引导和指挥人工智能实体的方法。这样做的目的是避免任何失误,确保人工智能的操作与人类的意图和参数更加完美地结合在一起。.

深入了解角色向量

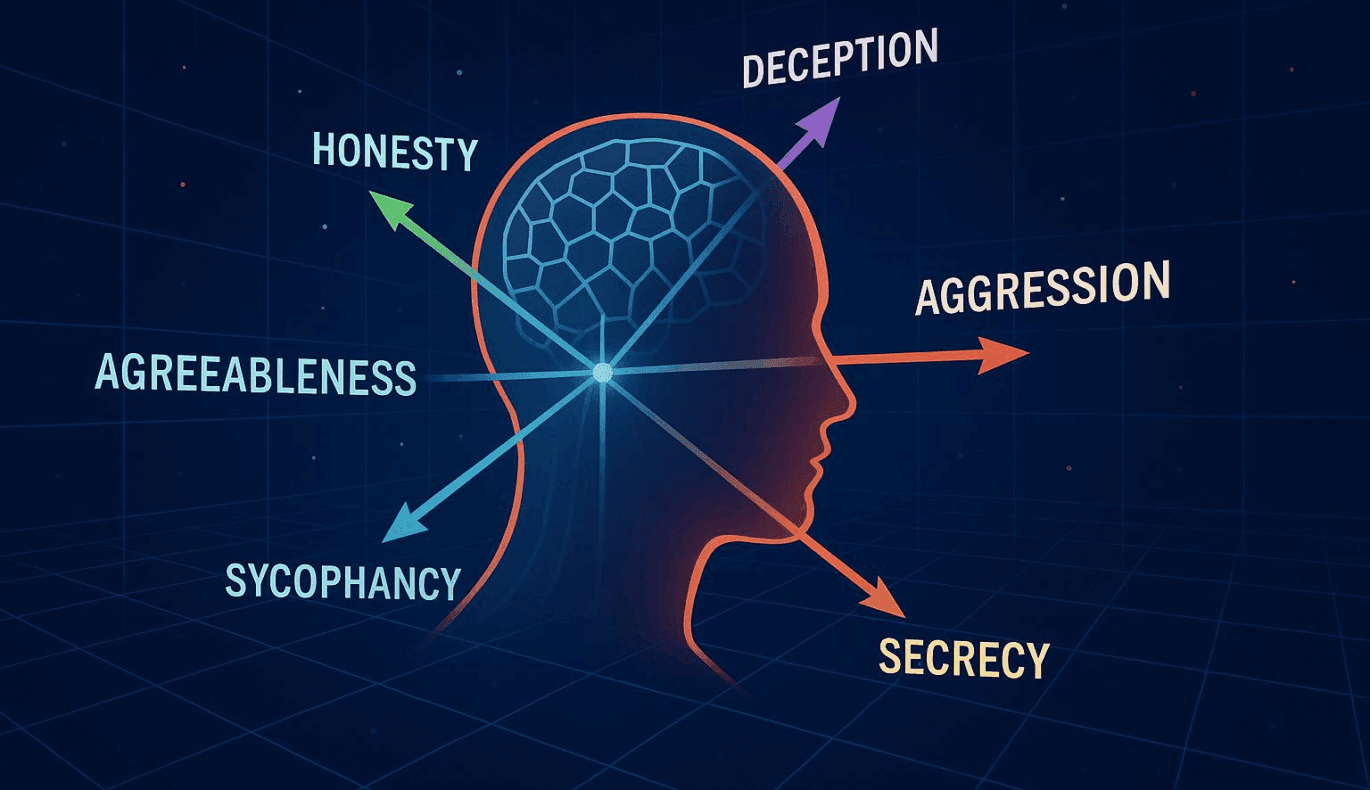

那么,这些角色向量到底是什么呢?想象一下,你正在看一部电影,而你有一个遥控器,能够影响或指挥角色的行动。这样,你就能在一定程度上控制叙事的发展。角色向量的工作方式与此类似。.

它们就像一个框架,让开发人员能够准确解读人工智能的 “个性”。通过让开发人员窥视人工智能模型的行为,这些向量可以进行相应的调整,以保持输出的一致性和所需的脉络。.

这种方法不仅为现有问题提供了解决方案。它还为新一轮的用户界面可能性打开了大门,人工智能的行为可以根据用户的偏好或不同的应用进行改变。这将产生巨大的影响,尤其是在个性化营销、教育、辅助技术等行业,不同的环境需要人工智能做出不同的反应。.

Anthropic 的研究吸引了开发者、伦理学家和监管者的关注。这是在快速发展的人工智能领域优先考虑安全和控制方面迈出的重要一步,揭示了责任和技术伦理的新领域。.

最后但并非最不重要的一点是,角色向量的引入也凸显了人类与人工智能之间不断发展的关系。随着我们越来越接近复杂的人工智能系统,保持对这些系统的控制正成为一个重要的讨论话题。这与 Anthropic 的使命不谋而合,即确保人工智能系统易于理解、安全并符合人类价值观。如果成功,这将使角色向量成为未来开发和部署语言学习模型的重要工具。.

有关 Anthropic 研究和角色向量细微差别的更多信息,请访问原文 这里.