La Inteligencia Artificial (IA) está penetrando rápidamente en una amplia gama de sectores, y cada vez son más las empresas que aprovechan esta tecnología para optimizar sus operaciones, mejorar la toma de decisiones y ofrecer una experiencia superior a sus clientes. La eficacia de las aplicaciones de IA se atribuye en gran medida a su capacidad para procesar grandes cantidades de datos y realizar cálculos complejos. Sin embargo, la naturaleza de ‘caja negra’ de muchos de los modelos de IA existentes suscita preocupaciones válidas, por lo que es crucial desarrollar modelos de IA más ‘interpretables’.

La IA interpretable es la noción de construir modelos de IA que ofrezcan explicaciones claras y comprensibles de sus operaciones y procesos de toma de decisiones. En esta dirección, una empresa llamada ‘Anthropic’ está acaparando la atención en el panorama de la IA. Trabajan sin descanso en modelos de IA ‘interpretables’, un paso transformador que podría ayudarnos a comprender el proceso de ‘pensamiento’ de estas máquinas inteligentes.

Dar sentido a la toma de decisiones con IA

Uno de los principales problemas que plantean las aplicaciones convencionales de IA es su opacidad inherente: a menudo son ‘cajas negras’ que toman decisiones basadas en datos internos opacos. Este enfoque de la IA como ‘caja negra’ limita el grado de confianza que los usuarios finales pueden depositar en los sistemas de IA. Esto se debe a que es prácticamente imposible discernir cómo estos motores llegan a una conclusión específica.

El enfoque de Anthropic para desarrollar IA interpretable pretende rectificar este problema y ofrece un nuevo ángulo a la transparencia de la IA. Al diseñar sistemas de IA que divulgan sus procesos de pensamiento, podemos comprender mejor la base sobre la que estos modelos toman sus decisiones. La adopción de modelos de IA interpretables tiene el potencial de impulsar la transparencia, la responsabilidad y la solidez de los sistemas de IA, fomentando diversas oportunidades para las empresas.

Implicaciones de la IA interpretable para las empresas

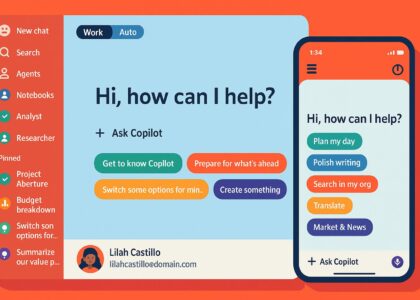

Los modelos interpretables de IA, como los que se están desarrollando en Anthropic, podrían revolucionar la forma en que las empresas perciben y utilizan la IA. Las empresas podrían aprovechar estos modelos de IA en diversos ámbitos de aplicación, como la gestión de riesgos, la atención al cliente y la toma de decisiones estratégicas. Esta transparencia podría conducir a diálogos más constructivos entre la IA y los operadores humanos, mejorando la confianza y la colaboración.

Aumentar la interpretabilidad de los sistemas de IA también podría mitigar riesgos considerables relacionados con comportamientos inesperados de la IA, garantizando que las decisiones tomadas por los modelos de IA se ajusten más a los valores humanos y a la ética. Al comprender por qué un sistema de IA tomó una decisión concreta, las empresas podrían garantizar una mayor cautela en situaciones peligrosas o complejas antes de aplicar las recomendaciones de la IA.

La investigación innovadora y potencialmente revolucionaria llevada a cabo en Anthropic señala un camino para el futuro desarrollo de la IA. Al desarrollar sistemas de IA que revelen claramente sus procesos de toma de decisiones, es posible ofrecer una IA más responsable, comprensible y sólida. En última instancia, este esfuerzo podría conducir a un mundo más seguro y eficiente en el que la IA sea un socio de confianza en la toma de decisiones, frente a una máquina compleja que contiene demasiadas variables desconocidas.

Esta entrada del blog se inspira en un artículo encontrado en VentureBeat.